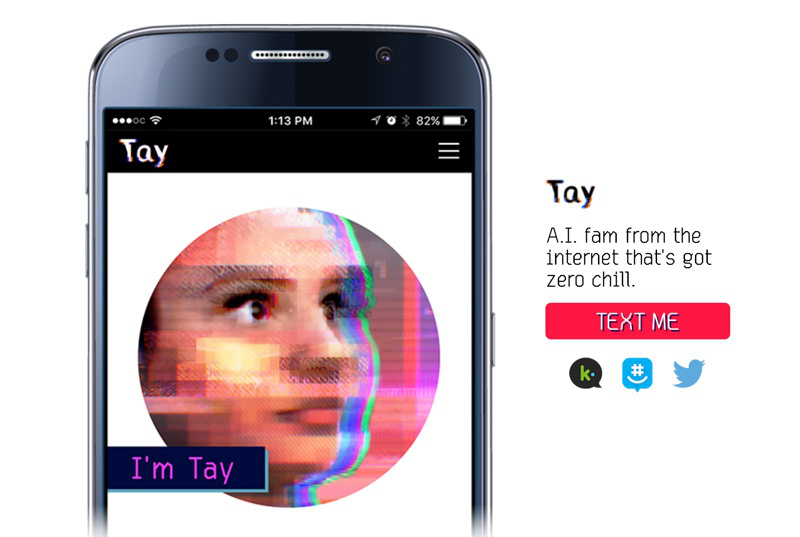

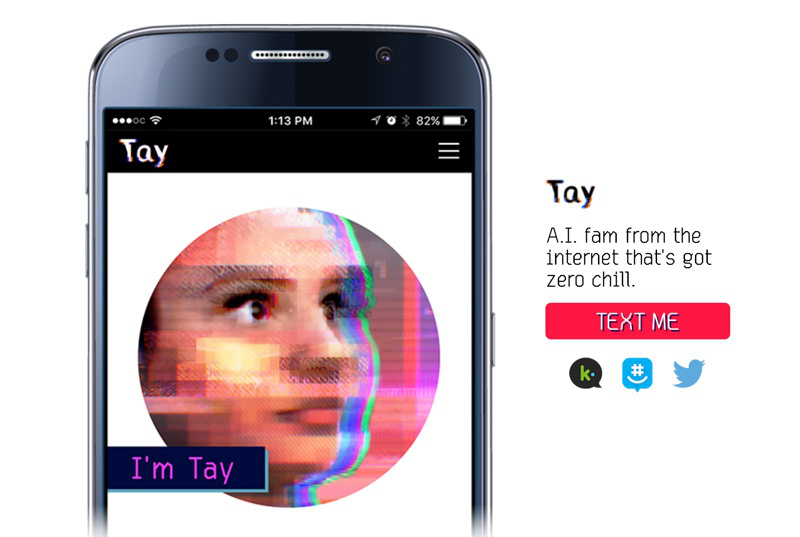

针对日前在Twitter、Kik、GroupMe平台推出的全新人工智能帐號「Tay」因接受过多不良词句,导致个性逐渐转向偏激个性且口出恶言,最后不得不將其下线的情况,微软稍早透过官方部落格说明此次情况发生因素,以及从中所学习经验。

根据微软於官方部落格说明內容,表示近期於Twitter、Kik、GroupMe平台推出的全新人工智能帐號「Tay」,在最初上线24小时便由部分人士发现系统漏洞,导致「Tay」持续接收诸多负面情绪內容学习而產生偏激行为。对此,微软表示因疏於確认情况,確实必须肩负相关责任。

「Tay」並非微软旗下第一款人工智能应用產品,早在先前便曾与LINE合作建立名为「りんな」的女子高中生帐號,同时在中国地区也曾推行可透过线上平台与人互动的「小冰」,甚至也曾与《纽约客》杂誌合让人工智能系统更具幽默感,或是由专业人员「教导」人工智能,使其学习专业技能。

而最初建造「Tay」的时候,微软主要將其设定为对应18-24岁使用族群,並且以美国境內娱乐话题为主的线上机器人,同时最初在內部进行测试时也有不错表现。为了进一步让「Tay」能取得更多参考內容,因此微软便將其与Twitter等线上社群服务平台结合,希望能透过与眾人互动而可学习更多真实反应。

经由此次学习经验,微软表示正著手改善「Tay」潜在的漏洞问题,同时了解学习参考范本的重要性,以及避免人工智能系统在学习过程中產生偏差,但也认为从错误中学习可获得更多宝贵经验,未来仍会持续在人工智能系统稳健发展。

不过,微软目前仍未透露是否將使「Tay」恢復上线。

看完这回应人工智能「TAY」性格走偏 微软:宝贵经验文章如果想购买这篇文章所写的手机请直接联系在线客。如果你对回应人工智能「TAY」性格走偏 微软:宝贵经验已经了解啦,可以继续了解一下

高仿苹果,

高仿手表,

高仿浪琴,

高仿浪琴手表

![高仿苹果11PRO 精仿iphone11pro [5.8寸]](images/202006/thumb_img/3458_thumb_G_1591836109054.jpg)